Um ano de blog!

Este post traz uma retrospectiva do que aconteceu por aqui em 1 ano de blog, foi muito empolgante o término do desafio que fiz a mim mesmo e a animação para novos desafios continua!

Até que um dia..

Agora em dezembro encerro um desafio pessoal de fazer pelo menos um post por mês durante o ano de 2018 e estou muito animado com o término deste ciclo! Espero ter contribuído um pouquinho com a comunidade de Estatística e Ciência de Dados que está maior a cada dia e cada vez mais importante.

A ideia de fazer um blog começou quando me deparei que tinha muitos scripts e rotinas guardados de alguns estudos sobre programação e estatística tanto sobre os assuntos da faculdade quanto sobre estudos avulsos de programação em R. Guardar os scripts de maneira organizada para relembrar e tentar fixar melhor alguns conceitos já vistos pode ser uma boa idéia acelerando o processo de busca por soluções para problemas computacionais do dia a dia.

Desde o início da graduação tomei o hábito de guardar todos meus arquivos no Dropbox (que é excelente ferramenta, inclusive porque é possível integrar com o R/Shiny). Até que um dia me dei conta de que estava acumulando cada vez mais scripts e relatórios em meu dropbox e além de não ser muito prático o acesso aos scripts, acaba não sendo muito dinâmico no compartilhamento com os membros da equipe, então passei a utilizar o Github para hospedar meus códigos, projetos, funções e estudos que poderiam tornar-se públicos e assim facilitar na hora de compartilhar algum código ou receber algum feedback.

Além do Github, o RPubs também foi útil para publicação de alguns trabalhos/projetos durante a graduação e alguns testes e contribuições nas competições e conjuntos de dados do Kaggle (além de bisbilhotar as resoluções dos top players) para aprender de uma maneira diferente um pouquinho mais a cada dia. Já no caso de trabalhos privados (solo ou em equipe), o Bitbucket também tem se mostrado uma ótima ferramenta.

Passei a receber feedback sobre meus códigos, sugestões de melhorias e isso me motivou a continuar e persistir nos posts independente de monografia, estágio, trabalho, ou qualquer outro compromisso super importante. Firmei esse desafio pessoal e abaixo será possível conferir um pouco de como foi minha evolução, algumas técnicas e curiosidades que aprendi e achei que valia a pena compartilhar com a comunidade.

Análise de sobrevivência com dados do jogo pubg disponíveis no kaggle

Calcular a probabilidade de um indivíduo sobreviver e também encontrar fatores de risco de morte em um intervalo de tempo. Foram realizadas estatísticas descritivas e o ajuste de modelos de sobrevivência como o de Kaplan-Meier e o Modelo de regressão de riscos proporcionais de Cox.

Seu app, RStudio e Shiny Server na nuvem do Google

Aprendemos como dar início à uma máquina virtual rodando Linux Ubuntu 16.04 no servidor do Google Cloud. Com nossa máquina virtual na configuração desejada somos capazes de dar início ao nosso próprio RStudio Server e também nosso Shiny Server para facilitar a entrega de nossas aplicações, como a que foi criada de exemplo no post para acompanhar as cotações e algumas ações de bolsas de valores americanas.

Com que frequência ocorrem acidentes na ponte rio-niteroi?

Neste post utilizamos os dados públicos fornecidos pela polícia rodoviária federal para responder algumas perguntas relacionadas à ocorrência de acidentes. Será que o número de acidentes vem diminuindo? Será que a instalação de câmeras de segurança reduziu o número de acidentes? Uma breve análise de caráter descritivo irá ajudar a entender o comportamento dos dados e permitir novas reflexões.

Um estudo sobre modelos de aprendizagem baseados em árvores com desafio do kaggle

Utilizamos a base de dados da competição do Kaggle House Prices: Advanced Regression Techniques para colocar em prática alguns dos conhecimentos adquiridos estudando sobre algoritmos como árvore de decisão, random forest, gradient boost machine e por fim uma regressão linear para comparar os resultados obtidos

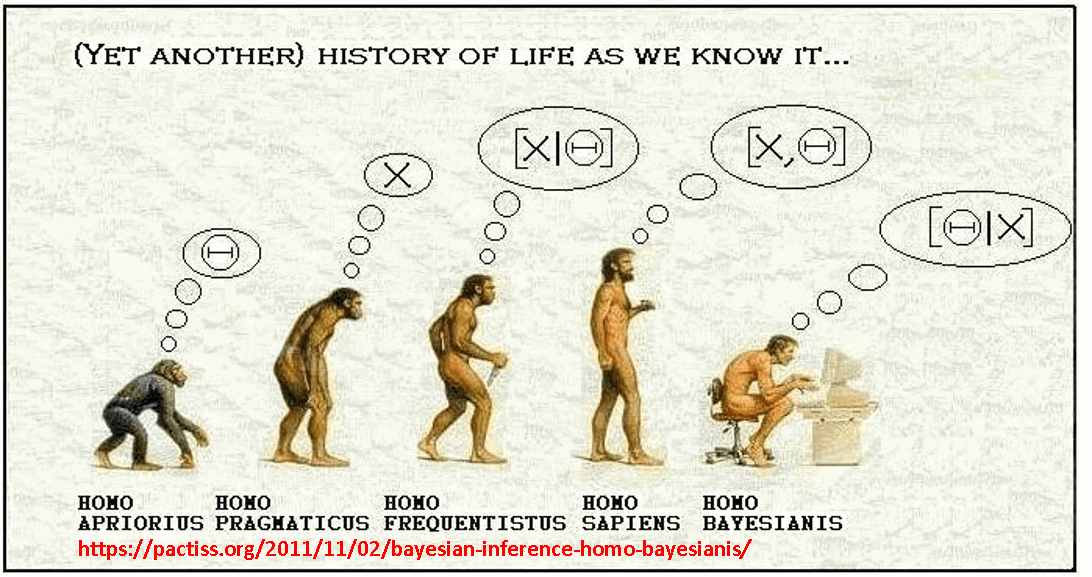

Ajustando um modelo de regressão linear bayesiano do zero

Neste post são realizados os cálculos das distribuições condicionais completas a posteriori (DCCP) para cada parâmetro do ajuste de um modelo de regressão linear bayesiano para poder implementar o algoritmo do amostrador de Gibbs em dados simulados (para conferir a qualidade do ajuste do modelo) e em dados reais. Este post é o resumo de uma das aplicações que fiz em um projeto de iniciação à pesquisa que deixei disponível no Github

Brasil x Argentina, tidytext e machine learning

Nesta época eu estava estudando o livro da Julia Silge depois de uma palestra que assisti no SER 2018 e aproveitando o embalo da copa do mundo resolvi conferir os dados do twitter disponibilizados através da API do Twitter naquela época para uma aplicação de análise de sentimentos utilizando a abordagem tidytext. Além disso foram utilizados os modelos knn, random forest, naive bayes e um modelo de regressão logístico para um estudo sobre classificação em análises de texto com o pacote caret

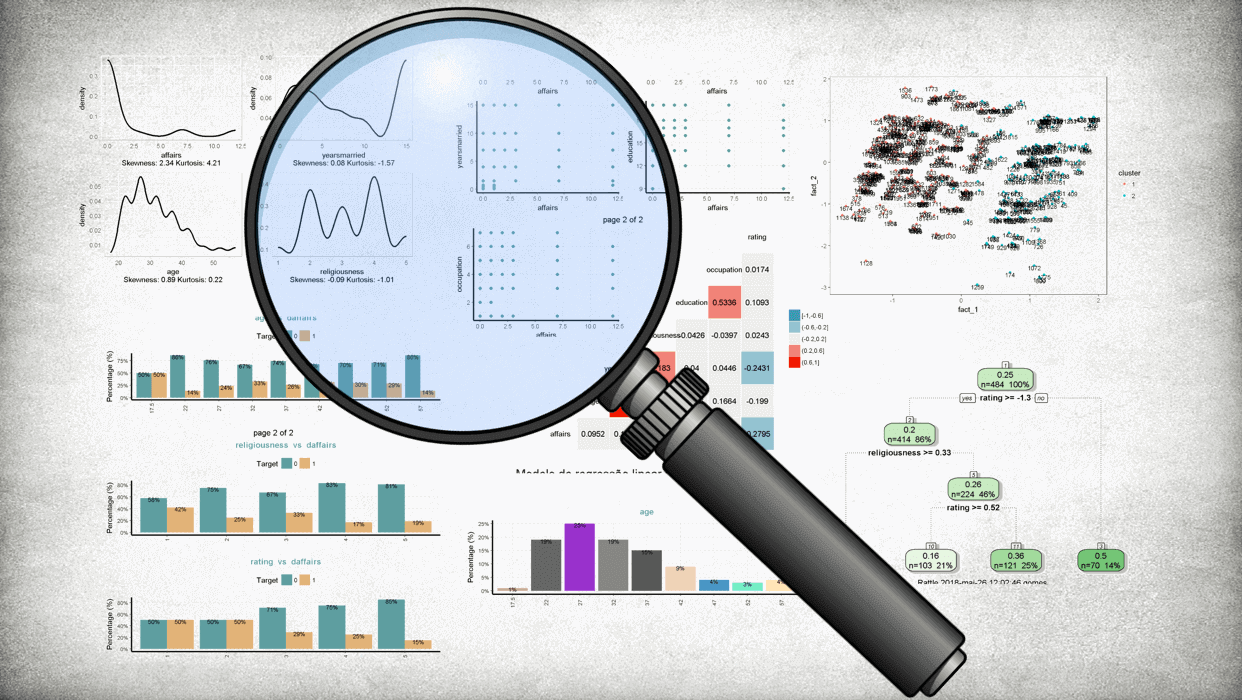

AED de forma rápida e um pouco de machine learning

Este post veio para lembrar como a análise exploratória em R não precisa sempre ser uma tarefa longa e trabalhosa. Com o pacote SmartEAD é possível gerar muitos gráficos com poucas linhas de código. Ao longo do post algumas tarefas de machine learning são executadas, como k-means (tarefa não-supervisionada de agrupamento), um modelo de regressão linear com stepwise (tarefa supervisionado de regressão) e um modelo random forest (tarefa supervisionada de classificação)

Séries temporais com google trends e R

Como é fácil obter dados do Google Trends para analisá-los no RStudio. Obtivemos algumas séries e duas delas chamaram mais a atenção: a popularidade do termo Big Data (que está aumentando) e a popularidade do termo Estatística que estava diminuindo. Realizamos a decomposição da série, realizamos alguns testes estatísticos para detectar significância dos componentes das séries e foram ajustados modelos de Holt Winters para tentar prever o comportamento destas séries no próximo ano.

Produzindo e formatando um documento word direto em R

O bom de programar em R é que não precisamos nos limitar apenas à ferramenta, podemos importar e exportar arquivos em diferentes formatos e entregas nossos resultados de muitas maneiras. Neste post é mostrado como exportar seus relatórios em Word utilizando um template.

O que são cheatsheets, gamificação e por que aprender R é tão divertido?

A aprendizagem é um processo que nunca acaba e neste post mostro algumas maneiras de estudar R e estatística se divertindo! Falamos o que são as CheatSheets, cursos da DataCamp, onde é possível ter cursos altamente práticos com os desenvolvedores dos principais pacotes utilizando em Ciência de Dados e falamos sobre a plataforma Kaggle, um verdadeiro playgroud para Cientistas de dados que podem disputar por posições em um rank mundial e compartilhar códigos e análises para ter o feedback de outros cientistas de dados ao redor do mundo

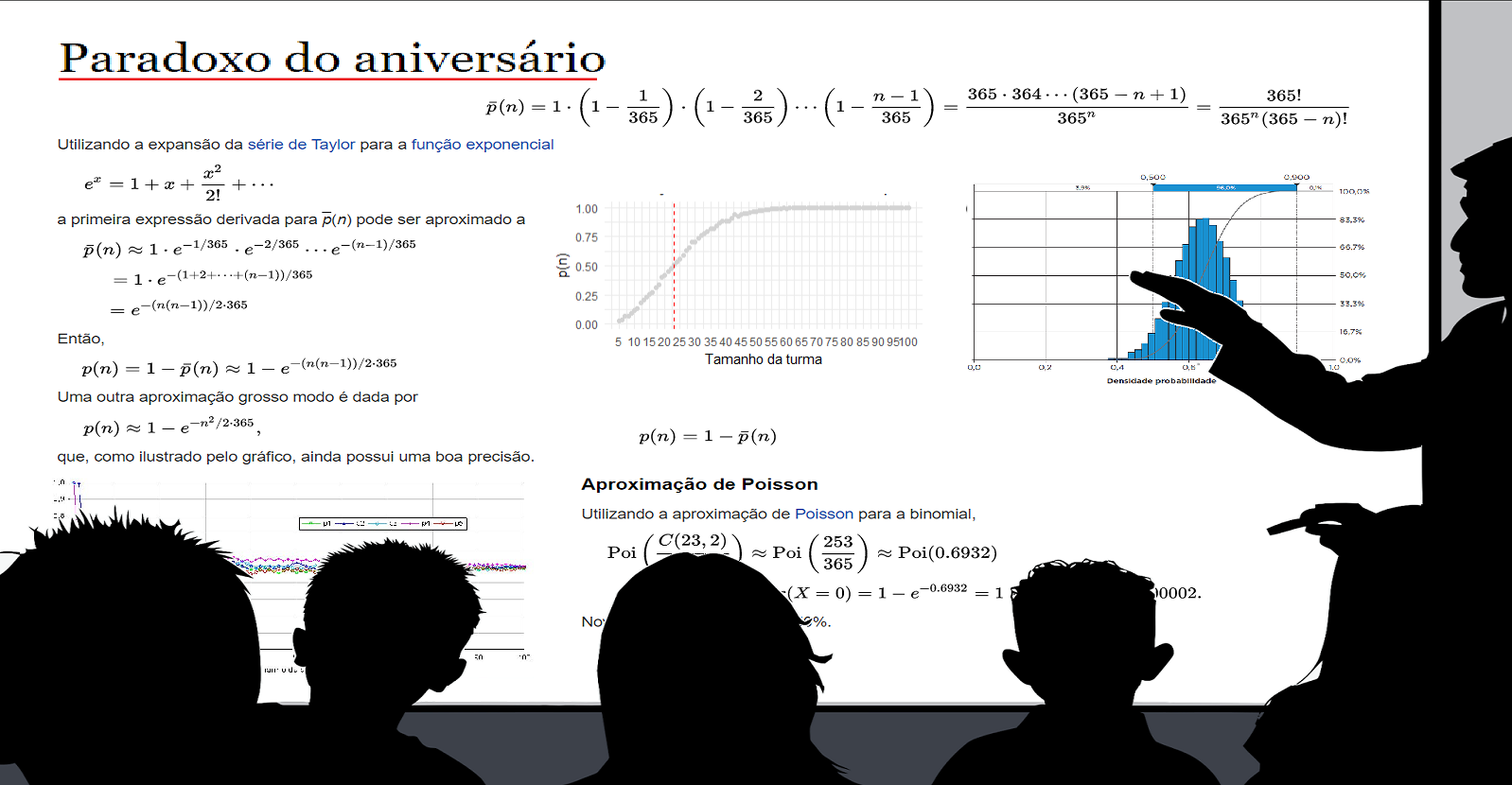

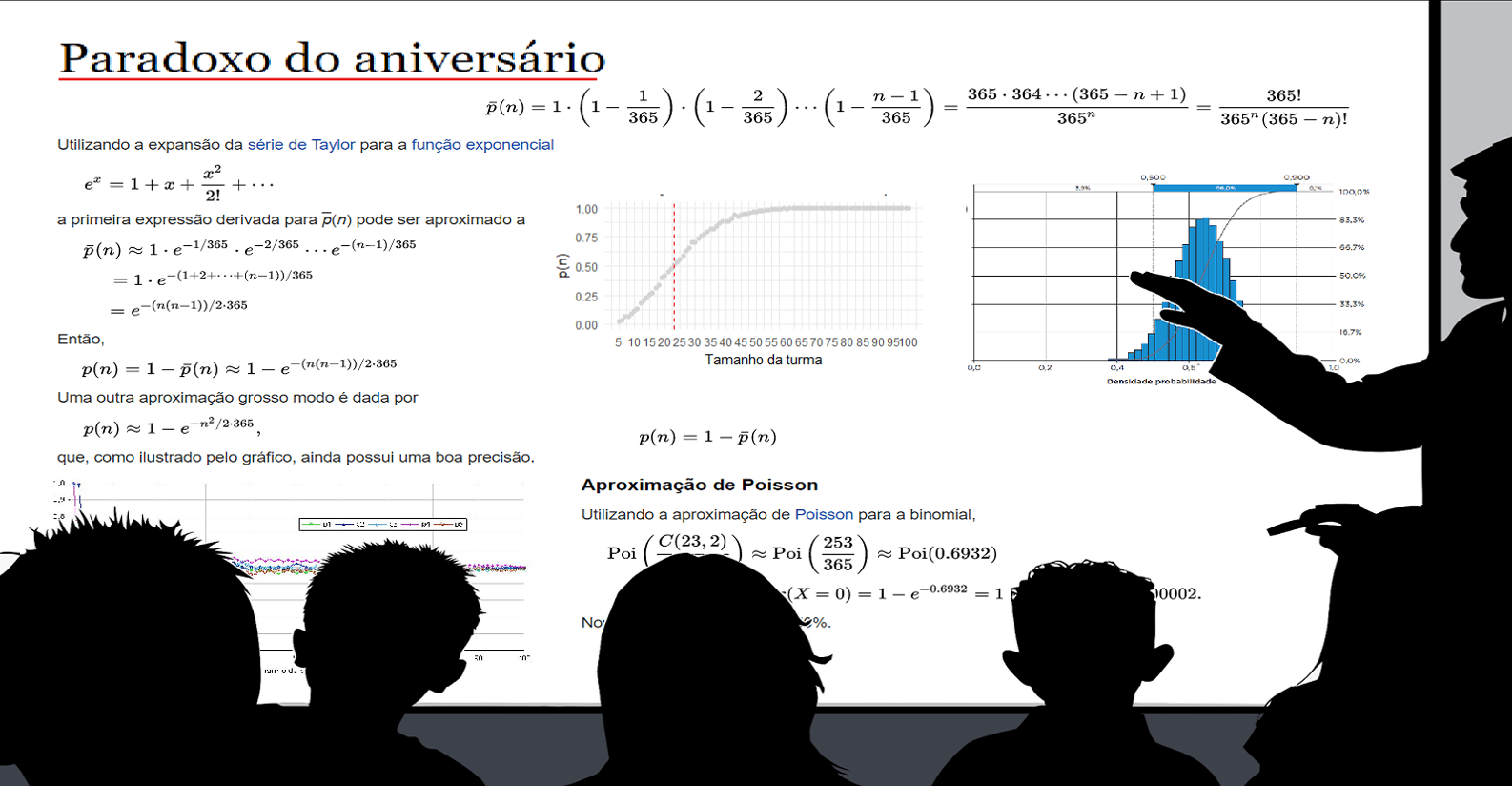

O paradoxo dos aniversários com simulação e probabilidade

A probabilidade é contra intuitiva. Existem diversos exemplos clássicos de probabilidade que nos mostram como pode ser enganosa nossa intuição ao tratar com a incerteza. Neste post utilizamos de simulação e de teoria das probabilidades para mostra como a probabilidade de duas pessoas fazerem aniversário no mesmo dia em uma sala de aula aumenta muito rápido conforme aumentamos o número de alunos nessa sala.

Tabelas incriveis com R

As saídas do console do R podem não ser a melhor forma de entregas suas valiosas análises. Quando estamos numa situação de negócios ou consultoria a apresentação dos dados também é muito importante e o R não fica para trás nisso! Neste post vimos alguns pacotes como o DT, knitr, kableExtra, formattable, sparkline e rhandsontable podem tornar a apresentação de nossas tabelas muito mais elegantes

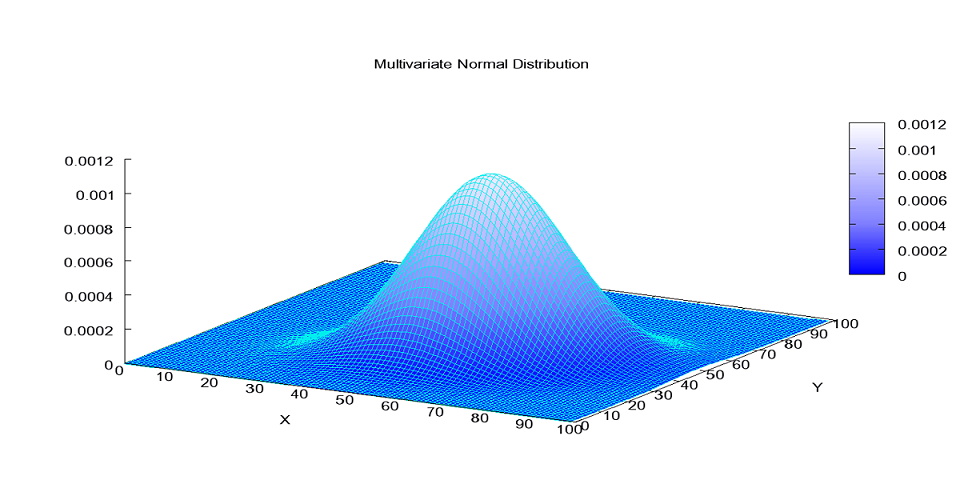

Análise multivariada com R

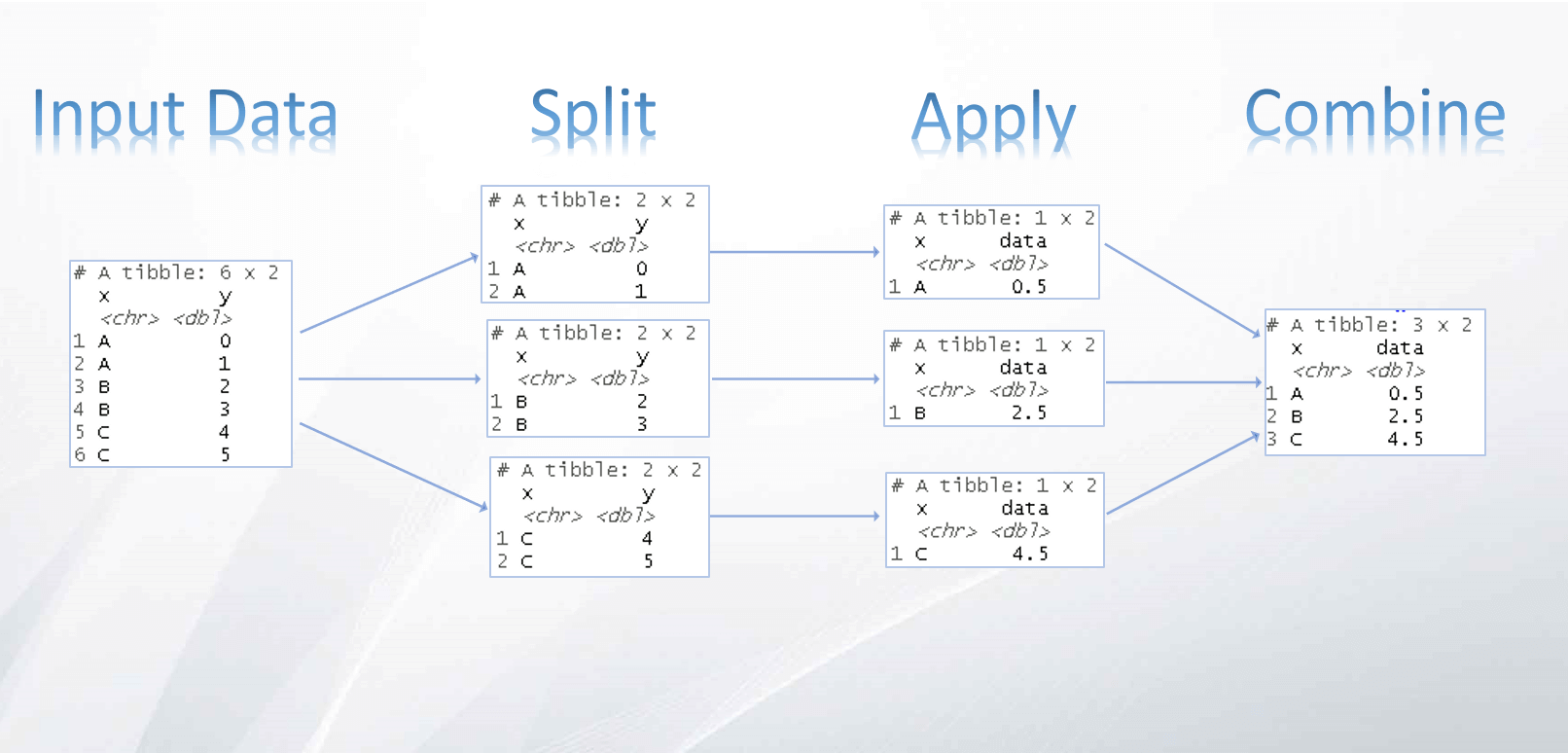

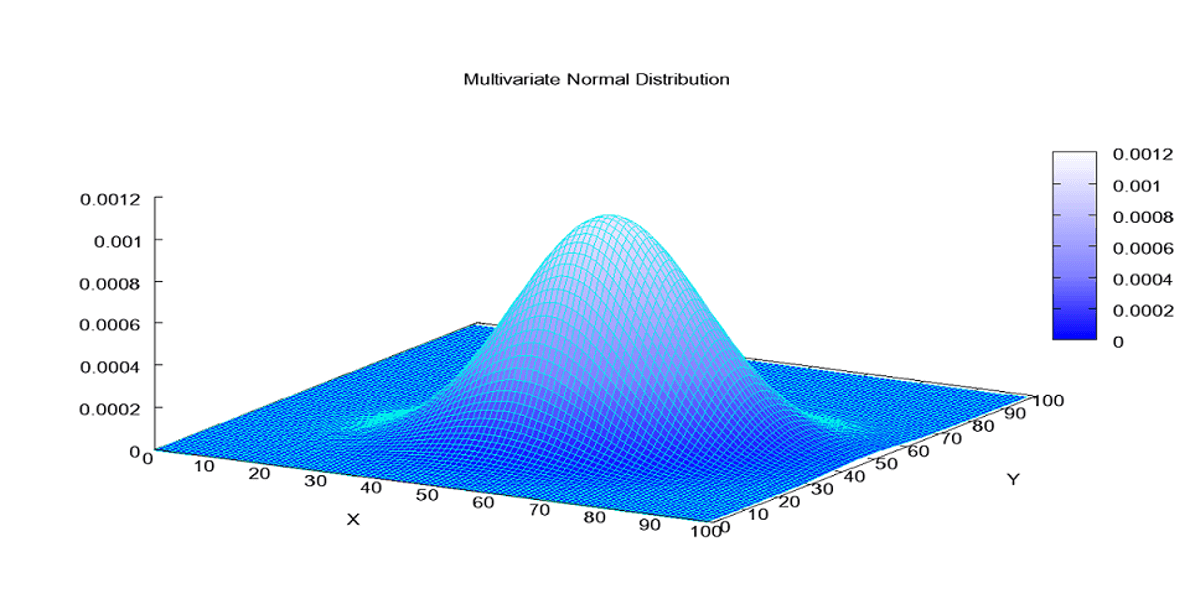

Em tempos de Big Data esse campo da estatística torna-se cada vez mais importante. Saber lidar com grandes volumes e variedades de dados pode ser muito importante e neste post vimos um pouco sobre técnicas de estatística multivariada como PCA, Análise Fatorial, Clusterização com agrupamento hierárquico e com k-means

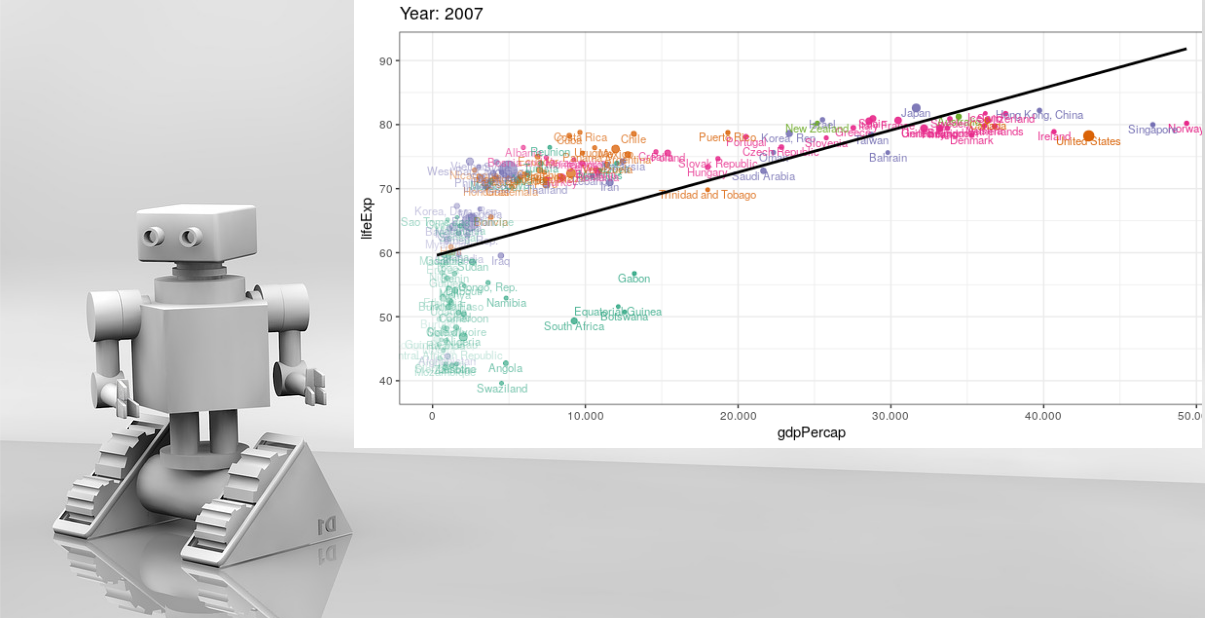

Pacotes do R para avaliar o ajuste de modelos

O Modelo de regressão linear é uma ótima ferramenta para qualquer estatístico, ele é altamente interpretável e seu a avaliação de seu desempenho pode ser feita de forma meticulosa. Neste post utilizamos os pacotes GGally e o ggfortify para fazer diagnósticos bem elaborados sobre as premissas que sustentam o uso de tais modelos

Além disso…

Além dos posts acima, também já passou por aqui:

Posts mais antigos

Além dos posts acima que ficaram em destaque, por aqui também foram postados:

Aplicativos Shiny

Esses são os aplicativos para uso público que desenvolvi (alguns ainda em faze de aprendizagem) que contam com os códigos hospedados no Github, além deles desenvolvi uma porção de aplicações que estão hospedadas no Bitbucket porém como são privados não poderei compartilha-las aqui:

Iniciação à Pesquisa:

Este foi um estudo sobre modelagem hierárquica sob a ótica da escola bayesiana para me preparar para escrever minha monografia, que contou com uma aplicação deste modelo na vida real:

Writer da ENSINA.AI

Esse ano também recebi um convite inesperado de participar como escritor contribuidor da página ENSINA.AI no medium, que tem como compromisso trazer ao público: Tudo sobre Inteligência Artificial em Português. Fiquei muito feliz com o convite pois já acompanhava a página e os posts sempre são muito bons! Os posts que contribui foram:

Boas festas!

Agora o ano está se encerrando e assim se encerra mais um ciclo, estou muito satisfeito pois aprendi muita coisa nova, interagi com muita gente inteligente e me diverti demais na produção deste blog.

Foram diversos desafios pois no começo foi bem complicado entender como manipular html, css e controlar as versões dos códigos no git pois era tudo muito novo mas o desafio valeu a pena, hoje aprendi um pouquinho sobre essas e outras ferramentas que um estatístico não vê na graduação e foi bem proveitoso em meus trabalhos. Se consegui ajudar pelo menos uma pessoa já atingi minha meta, se ajudei duas pessoas então consegui dobrar essa meta!

Se souber exatamente o que fazer, qual a vantagem de fazê-lo? - Pablo Picasso

Agora no ano de 2019 “fazer pelo menos um post por mês” não estará em meus planos, mas já tenho diversas ideias de posts e continuarei escrevendo em um ritmo um pouco mais calmo pois os estudos estão cada vez mais difíceis!

Espero que tenham gostado do conteúdo e obrigado por toda ajuda direta ou indiretamente de cada membro da comunidade que fez valer a pena cada minuto de esforço!

Share this post

Twitter

LinkedIn

Email